Spielregeln & Umgebung

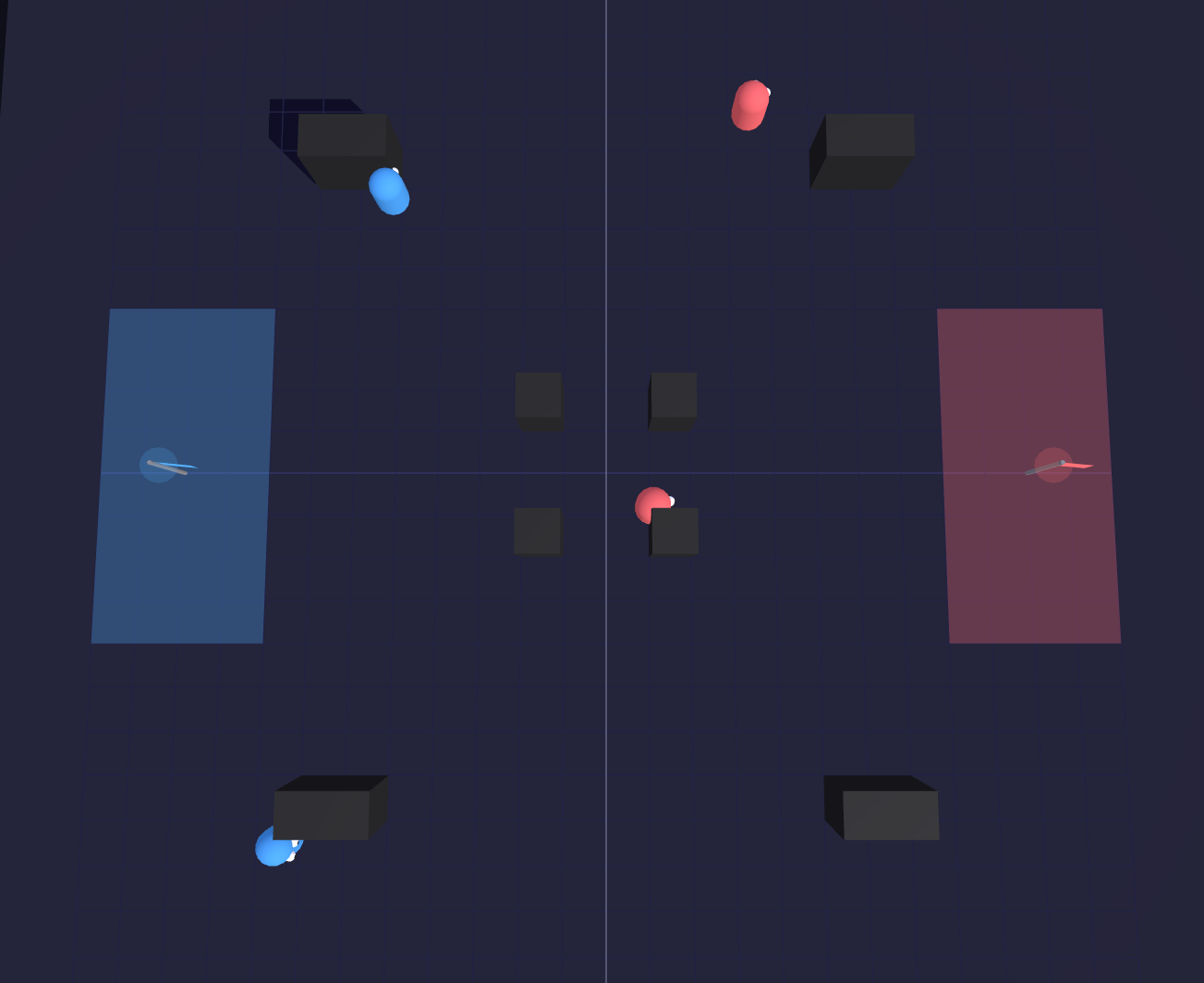

Ein symmetrisches Schlachtfeld für kompetitive Agenten.

Flagge erobern

Das Kernziel: Gegnerische Flagge stehlen und zur eigenen Basis bringen.

- +100 Punkte pro erfolgreichen Capture

- Eigene Flagge muss in der Basis sein

- 3 Captures = Sieg

- Träger ist 30% langsamer

Tackle & Stun

Nahkampf-Angriff betäubt Gegner für ~1 Sekunde.

- Cooldown: 3.25 Sekunden

- Betäubte lassen Flagge fallen

- +8 Punkte für Tackle auf Flaggenträger

Territorium

Die Spielfeldhälfte bestimmt die Rolle des Agenten.

- Eigene Hälfte: Verteidiger-Status

- Gegnerseite: Angreifer (verwundbar)

- Flaggenträger immer angreifbar

- Safe Zone in der Basis

Observation Space

Jeder Agent erhält 31 kontinuierliche Werte pro Frame.

- Position, Flaggen-Status, Stun-Timer

- Vektoren zu Basen & Flaggen

- Positionen von Team & Gegnern

- Wände blockieren keine Sicht